Collaborer avec la machine : quels changements pour l’opérateur ?

Remerciements

Susana Sánchez Restrepo est docteure en robotique et automatisation. Elle a réalisé sa thèse au CEA List et au LAAS-CNRS. Elle est aujourd’hui ingénieure de recherche software chez Softbank Robotics où elle travaille sur des robots humanoïdes et de service, pour améliorer leur capacité d’expression et leur niveau d’interaction avec les humains. Elle remercie Xavier Lamy, Gennaro Raiola et Sara Sánchez Restrepo.

Alina Glushkova et Sotiris Manitsaris sont chercheurs au Centre de robotique de Mines ParisTech et responsables du Mastère spécialisé Intelligence Artificielle et Mouvement dans les Industries et la Création. Une partie des travaux mentionnés dans ce Doc ont été réalisés dans le cadre de la chaire Robotique et Réalité Virtuelle de PSA Peugeot-Citroën – Mines ParisTech et du projet de recherche Collaborate n°820767, financé par le programme de recherche et d’innovation Horizon 2020 de l’Union européenne.

Avant-propos

La collection des « Docs de La Fabrique » rassemble des textes qui n’ont pas été élaborés à la demande ni sous le contrôle de son conseil d’orientation, mais qui apportent des éléments de réflexion stimulants pour le débat et la prospective sur les enjeux de l’industrie.

À l’heure où l’industrie du futur est présentée comme une des solutions au maintien ou au retour de la production sur le territoire national dans un contexte de crise sanitaire et économique, cette étude apporte un éclairage pédagogique sur la robotique collaborative, exemples à l’appui. Elle inscrit les robots collaboratifs dans le prolongement des robots industriels traditionnels et en décrit les enjeux pour l’opérateur.

Cette étude s’appuie d’une part sur la thèse de Susana Sánchez Restrepo, co-lauréate de l’édition 2019 du concours pour étudiants et jeunes chercheurs organisé par La Fabrique de l’industrie. D’autre part, elle évoque des résultats de recherche du centre de robotique de Mines ParisTech.

Nous espérons que ce document offrira aux industriels un complément d’information sur les solutions techniques aujourd’hui disponibles et fera émerger l’envie chez les jeunes adultes de travailler en environnement industriel, pourquoi pas avec des robots collaboratifs. Nous recueillerons avec grand intérêt vos retours et notamment les pratiques de terrain à l’œuvre dans ce domaine.

L’équipe de La Fabrique

Synthèse

Depuis les années 1960, la robotique a participé à la transformation de l’industrie. Aujourd’hui encore, elle présente de vastes opportunités pour gagner en productivité, flexibilité et capacité de personnalisation. La robotique collaborative est l’une d’entre elles. L’opérateur peut désormais travailler dans le même espace que le robot tout en étant en sécurité. Ce robot lui apporte une assistance comme le ferait un outil ou un collègue. Dans le premier cas, l’opérateur demeure le maître de la décision : le cobot-outil est là pour prolonger le mouvement de l’opérateur quand celui-ci l’a décidé. Dans le second, la prise de décision est partagée : les avancées en matière d’intelligence artificielle permettent aujourd’hui à la machine d’anticiper les mouvements de l’opérateur et donc de s’y adapter, par exemple pour lui tendre un objet au bon moment et à la bonne hauteur. Dans tous les cas de figure, il faut au préalable enseigner au robot à travailler avec l’opérateur, que ce soit en lui apprenant à reconnaître les gestes humains ou en lui montrant le geste à reproduire. Différents modes d’apprentissage peuvent alors être mobilisés parmi lesquels l’apprentissage automatique et l’apprentissage par la démonstration. Ce dernier présente le grand avantage de pouvoir être pris en charge par l’opérateur lui-même.

La robotique collaborative offre donc une nouvelle forme d’assistance dans la réalisation d’une tâche, qui rend le travail moins pénible physiquement et psychologiquement et favorise la montée en autonomie et la polyvalence.

Introduction

Imaginez-vous en train de travailler avec un robot. En serez-vous le maître ou l’assistant ? Quel contact pouvez-vous avoir avec lui tout en étant en sécurité ? Comment pouvez-vous vous synchroniser avec lui ? Comment votre collaboration peut-elle être le reflet d’une complémentarité entre vos qualités et les siennes ?

L’utilisation des robots dans l’industrie n’est pas nouvelle. Les premiers robots industriels ont en effet été conçus et commercialisés dans les années 1960 pour réaliser de manière automatique des tâches simples, répétitives, pénibles et dangereuses à la place des humains et ce, de manière plus rapide et plus précise. Se distinguant des automates par leur possibilité de reprogrammation et leur dimension multifonctionnelle, ils ont favorisé une augmentation de la productivité et de la qualité ainsi que la réduction des coûts opérationnels de fabrication. La robotique a évolué en même temps que la mécanique, l’électronique, l’informatique, les mathématiques appliquées et le génie des matériaux, ce qui a favorisé l’émergence d’une diversité de robots, parmi lesquels les robots collaboratifs.

Aujourd’hui, la robotique collaborative ou cobotique représente une opportunité supplémentaire d’améliorer la performance des entreprises ; c’est aussi l’occasion de repenser les relations homme-robot à l’aune de leur complémentarité. Nous ne chercherons pas dans ce Doc à évaluer le rôle de la cobotique dans l’évolution de l’emploi, d’autant moins que l’utilisation de robots collaboratifs est encore marginale. Notre contribution apporte plutôt un éclairage sur ce champ en émergence, à l’aide d’exemples qui permettent de mieux saisir la diversité des robots collaboratifs et la perspective de collaboration qu’ils offrent entre l’opérateur et le robot. Nous posons la question des changements liés à leur utilisation pour l’opérateur durant l’exécution de la tâche et sa programmation.

Le premier chapitre s’intéresse à la définition de la robotique collaborative et à ses enjeux économiques et organisationnels. Le chapitre deux s’intéresse aux types d’assistance apportée par le robot collaboratif en milieu industriel en distinguant le cobot-outil et le cobot-collègue. Ces deux cas sont illustrés à partir des travaux de Susana Sánchez Restrepo et du centre de robotique de Mines ParisTech. La phase d’apprentissage du robot pour reconnaître les gestes de l’opérateur et s’adapter à celui-ci, ou pour reproduire un geste instruit, fait l’objet du troisième et dernier chapitre de cette étude.

Le robot collaboratif, un robot pas comme les autres?

La diffusion des robots collaboratifs participe du mouvement plus général d’évolution de la robotique : ils permettent à une usine de gagner en flexibilité et en productivité tout en améliorant l’ergonomie des postes de travail, s’inscrivant en cela dans la continuité des autres robots industriels. Toutefois, ils s’en distinguent principalement par leur fonctionnement dans un espace partagé avec l’humain. Nous conclurons ce premier chapitre en montrant que la robotique collaborative induit de nouveaux modes d’interaction entre l’opérateur et le robot, qui s’incarnent notamment dans les deux cas de figure que nous avons appelés le cobot-outil et le cobot-collègue.

Un robot sorti de sa cage

Figure représentative de l’usine du futur, le robot dit « collaboratif » renouvelle l’image des robots industriels « en cage ». Ces derniers ont été commercialisés dans les années 1960 pour réaliser de manière automatique des tâches simples, répétitives, pénibles et dangereuses à la place des humains et ce, de manière plus rapide et plus précise. À la différence de ces premiers robots industriels, placés dans des environnements clos pour assurer la sécurité des opérateurs, les robots collaboratifs savent travailler en environnement ouvert. L’enjeu de la sécurité se transforme : l’opérateur et le robot collaboratif évoluent dans un espace commun, ce qui soumet l’opérateur aux risques de choc avec les éléments en mouvement du robot. Des dispositifs, encadrés par des normes ISO (ISO/TS 15066), existent pour prévenir les chocs accidentels ou pour limiter leur impact, tels que le ralentissement du robot en cas de non-respect de la distance de sécurité entre l’opérateur et le robot ou la limitation de la force du robot en cas de contact.

Encadré 1 – Aux origines de la robotique collaborative

Le terme cobot, néologisme issu de «collaboration» et de «robotique», est apparu en 1996 pour désigner un dispositif robotique manipulant des objets en collaboration avec un opérateur (Colgate et al., 1996) Cette définition désigne essentiellement la comanipulation, c’est-à-dire la manipulation conjointe d’objets par un opérateur humain et un robot dans le même espace de travail La notion de robotique collaborative est devenue moins spécifique aujourd’hui et s’applique à tout robot capable de partager le même espace de travail que les opérateurs et d’interagir avec eux de manière sûre Elle englobe désormais non seulement la comanipulation mais aussi le téléguidage et les exosquelettes (Moulières-Seban et al., 2016) La norme ISO/TS 15066 définit le robot collaboratif comme «un robot conçu pour une interaction directe avec l’humain à l’intérieur d’un espace de travail collaboratif délimité» et l’espace de travail comme «le périmètre de sécurité où le robot et l’humain peuvent réaliser leurs tâches simultanément pendant la production »

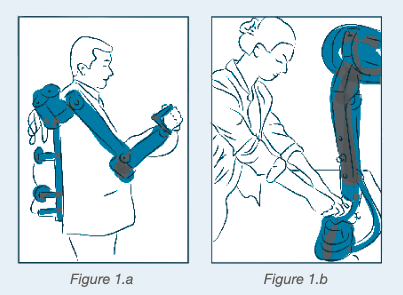

Figure 1 – L’exosquelette et le bras manipulateur

Source : Sánchez Restrepo (2018)

L’exemple le plus connu du robot collaboratif est sans doute celui de l’exosquelette, qui vient augmenter les capacités de l’utilisateur en répartissant l’effort à fournir sur différents points de contact du corps humain (Figure 1a) Le bras manipulateur dont l’opérateur manoeuvre directement la partie terminale correspond au cas de figure du cobot-outil que nous développerons plus loin (Figure 1b)

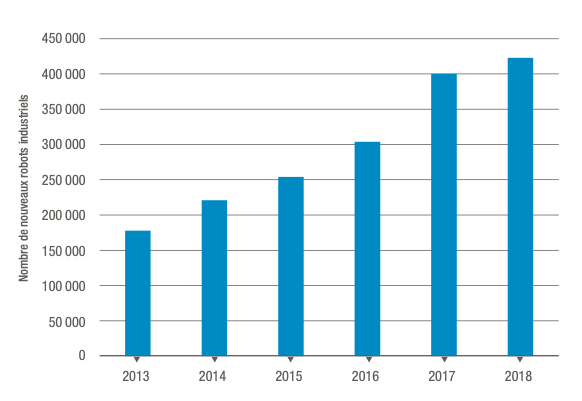

Le développement des robots collaboratifs s’inscrit dans un mouvement d’accroissement de la robotique industrielle dans le monde. D’après la Fédération internationale de robotique, le nombre de nouveaux équipements en robots industriels est en effet passé de 178 000 unités en 2013 à 422 000 en 2018, avec un ralentissement de la croissance observée la dernière année (Graphique 1)1.

Graphique 1 – Nombre de nouveaux robots industriels déployés dans le monde sur la période 2013 – 2018

Source : Fédération internationale de robotique (2019)

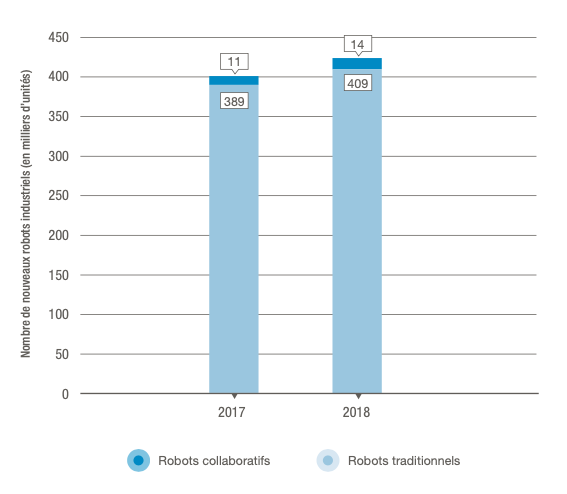

Les robots collaboratifs représentent encore un faible pourcentage de ces nouveaux équipements des sites de production. En 2018, seuls 3,3 % des nouveaux robots installés dans le monde étaient des robots collaboratifs (Graphique 2). Toutefois, le nombre de robots collaboratifs vendus a connu une croissance de 23 % entre 2017 et 2018 contre 5,1 % pour les robots traditionnels.

Graphique 2 – Nombre de nouveaux robots industriels traditionnels et collaboratifs déployés dans le monde en 2017 et en 2018

Source : Fédération internationale de robotique (2019)

Encadré 2 – Un marché dominé par quelques acteurs

Le marché mondial des robots collaboratifs, très concentré, est dominé par la société danoise Universal Robots dont la part de marché est de 46% en 2017.

Aucune autre société ne détient une part supérieure ou égale à 10% En 2018, on dénombre une trentaine de sociétés vendant 80 modèles de robots collaboratifs.

La répartition des parts de marché est toutefois amenée à évoluer sous l’effet de la concurrence accrue provenant des sociétés chinoises et taïwanaises ainsi que des plus grandes sociétés de robots traditionnels.

Source : Sharma (2018), données du rapport écrit par Interact Analysis

Collaborative Robots – 2018

Des gisements de productivité multiples

Un effet important sur l’ergonomie du poste

Les robots collaboratifs ont un rôle à jouer sur la santé des travailleurs, notamment par la baisse de la pénibilité et des troubles musculo-squelettiques (TMS) qui en découlent. Plusieurs risques professionnels ont pu être identifiés comme des sources de pénibilité physique ou psychologique : ils peuvent être liés à des contraintes physiques marquées (transport ou soutien d’une charge, postures inadéquates, vibrations mécaniques), un environnement physique agressif (exposition à des agents chimiques dangereux, bruits, températures extrêmes) ou à certains rythmes de travail (travail de nuit, répétitif) (INRS, 2019).

Les TMS représentent 87 % des maladies professionnelles en 2017 selon l’Agence nationale de santé publique (2020) et sont un facteur de coût pour les entreprises (Encadré 3).

Encadré 3 – Les coûts liés aux TMS pour une entreprise

Coûts directs entre 100 et 500 euros

+ Coûts indirects entre 200 et 3 500 euros

Total = entre 300 et 4 000 euros par an et par salarié

soit pour une entreprise avec 4 000 salariés :

entre 1 200 000 et 16 000 000 euros par an

Les coûts directs comprennent les cotisations versées à l’assurance maladie par l’employeur, les indemnités versées aux salariés, les frais liés à la recherche et à l’aménagement des postes de travail et le temps consacré à la gestion des dossiers des salariés.

Les coûts indirects sont liés au remplacement de l’opérateur malade, au temps nécessaire pour former un nouvel opérateur et à la perte de production liée aux délais et à la qualité.

À ces coûts peuvent s’ajouter les coûts stratégiques qui sont liés à l’effet des TMS sur la capacité de la firme à mobiliser ses opérateurs pour maintenir ou gagner des parts de marché ou sur l’image de l’entreprise.

Ces effets sont néanmoins difficilement quantifiables.

Source : ANACT (2007).

La pénibilité psychologique pour l’opérateur peut aussi se traduire par des risques psychosociaux2 qui peuvent être partiellement limités par l’assistance offerte par la robotique collaborative : notamment, l’opérateur n’a pas besoin d’être aussi concentré qu’il le serait s’il devait exécuter le geste parfait à chaque fois. Il peut néanmoins être difficile de tirer des généralités car cette même assistance peut aussi avoir des effets négatifs chez certains : elle peut par exemple être vécue comme une source d’exigence supplémentaire par l’opérateur qui peut penser que l’erreur est moins bien tolérée.

Un effet encore inconnu sur l’emploi

Ces effets positifs de la cobotique sur la pénibilité du travail semblent favoriser, toutes choses égales par ailleurs, l’emploi des seniors et des femmes sur des postes qui étaient précédemment occupés plutôt par des hommes relativement jeunes. En outre, pour des raisons de productivité, un robot collaboratif sera en principe mobilisé sur des tâches qui sont plus efficacement réalisées par son apport et celui d’un opérateur plutôt que par deux robots ou deux humains. Notons toutefois que, comme dans le cas des robots traditionnels (Encadré 4), l’effet des robots collaboratifs sur l’emploi est difficile à quantifier.

Encadré 4 – Un effet sur l’emploi difficile à mesurer

L’hypothèse répandue concernant l’effet des robots sur l’emploi est la substitution de l’humain par le robot. Plusieurs études ont cherché à quantifier cet effet de remplacement (Frey et Osborne, 2013, 2017 ; Bowles, 2014 ; Arntz, Gregory et Zierahn, 2016 ; Le Ru, 2016). Pour cela, elles partent de l’hypothèse que les tâches qui vont disparaître sont les tâches qui sont automatisables. Par exemple, Le Ru (2016) estime que le nombre d’emplois automatisables en 2030 en France sera de 3,5 millions, représentant 15 % de l’emploi total.

Or, la relation entre robotisation et emploi n’est pas automatique, d’autres facteurs tels que le degré d’acceptabilité par la population et la rentabilité économique entrent en considération. Surtout, l’automatisation a deux effets contradictoires sur l’emploi (Acemoglu et Restrepo, 2019. D’une part, elle supprime des postes en modifiant le contenu du travail (effet de remplacement. D’autre part, elle augmente la productivité du travail (effet de productivité), entraînant une augmentation de la demande de travail pour les tâches non automatisées, ce qui a un effet positif sur l’emploi et sur le niveau des salaires.

L’augmentation des salaires peut être source d’une nouvelle demande auprès d’autres secteurs. Quand les études mentionnées précédemment ne peuvent faire mieux que d’évaluer un effet brut du robot sur l’emploi, le solde net dépend en réalité du jeu entre ces effets*. De manière générale, et comme le soulignent Mercier et Savary, « il est hasardeux voire impossible de quantifier […] les effets nets sur l’emploi du processus de robotisation et d’appropriation de l’intelligence artificielle par les différentes branches de l’économie » (2019, p. 40).

*Voir Bidet-Mayer (2015) et Bourdu et Weil (2016) pour une discussion plus détaillée de ces effets ; voir Acemoglu et al. (2020) pour une évaluation dans le cas de la France.

Une montée en compétences possible

Avec l’arrivée des robots collaboratifs, l’humain peut se concentrer sur des tâches mobilisant davantage sa dextérité ainsi que sa capacité à prendre des décisions et déléguer au robot les tâches qui, en plus d’être pénibles et répétitives, ne mobilisent pas sa capacité de réflexion. De fait, à l’heure actuelle, les avancées technologiques permettent difficilement de remplacer l’humain par la machine dans des fonctions telles que la créativité, la réactivité au changement ou la socialisation, en particulier lorsqu’elles s’appuient sur de la communication non-verbale3. Pour l’opérateur, l’acquisition d’un robot collaboratif peut en effet représenter une opportunité d’acquérir des compétences plus transversales ou soft skills qui s’expriment notamment par une montée en autonomie et une amélioration de sa polyvalence.

Cette montée en compétences s’avère néanmoins conditionnelle car elle dépend d’un certain nombre de décisions de la part de l’entreprise. Tout d’abord, il ne faut pas oublier que l’adoption d’une nouvelle technologie vient avec une certaine contingence organisationnelle (voir par exemple Moniz et Krings, 2016). La simplicité d’utilisation et de reprogrammation des robots collaboratifs, que nous verrons dans le détail plus loin, présente un intérêt limité si l’opérateur doit faire valider chaque changement de configuration par son contremaître. Une telle responsabilisation des travailleurs est donc conditionnée par le choix de management. En outre, un accompagnement semble souhaitable afin d’assurer cette montée en compétences pour un maximum de collaborateurs. S’il existe des interfaces d’utilisation suffisamment intuitives pour que l’opérateur n’ait pas besoin d’être formé pour interagir avec certains robots collaboratifs, un travail sera sans doute nécessaire chez certains : il s’agit de favoriser le développement des soft skills en lien avec la gestion du temps, la pensée critique ou encore le leadership (voir Ras et al., 2017) qui forment le socle de la capacité à prendre des décisions informées.

La montée en compétences est plus généralement associée à l’avènement de l’industrie 4.0 et des smart factories, ces usines qui prennent en considération les informations dites de contexte telles que la position des objets pour assister les machines et l’humain dans l’exécution de leurs tâches (Lucke et al., 2008).

Des gains en flexibilité

À l’instar d’autres robots industriels récents, le robot collaboratif permet de mieux gérer les changements de produits ou d’environnement de deux manières. D’une part, il favorise la réalisation de séries personnalisées. En raison de son poids généralement léger, il peut aisément être redéployé à un autre endroit de l’usine, ce qui permet de reconfigurer la ligne de production en un temps limité. Souvent, il est également équipé d’une interface de programmation intuitive qui le rend plus facilement reconfigurable. D’autre part, le roulement entre les opérateurs peut être facilité grâce à cette interface intuitive, qui laisse l’opérateur faire les ajustements nécessaires lui- même, ou grâce à l’intelligence artificielle, qui permet au robot de s’adapter automatiquement à la cadence de l’opérateur voire même à son gabarit.

Co-présence, coopération et collaboration : trois régimes d’interaction

Depuis l’avènement de la cobotique, l’opérateur doit apprendre à composer avec un nouvel « acteur » dans son espace de travail habituel : comment faire en sorte qu’il ne vive pas cette arrivée comme une intrusion ? Quelles tâches devra-t-il céder au robot collaboratif ? Comment se coordonnera-t-il avec lui ?

Un champ de recherche dédié aux interactions homme-robot (HRI)

Un champ de recherche à part entière est dédié à ces questions. Il s’agit de l’approche interdisciplinaire dite « interaction homme-robot » (HRI en anglais), mêlant robotique, psychologie et ergonomie. Pour être plus précis, le champ des HRI ne se limite pas à la cobotique mais s’intéresse plus généralement aux relations possibles entre l’humain et le robot. Schmidtler et al. (2015) classent ces relations selon quatre critères :

– l’espace physique (robot en cage ou non) ;

– le moment d’intervention (même plage horaire ou non) ; – le but de l’action (tâche commune ou non) ;

– le contact (volontaire coordonné ou accidentel).

Partant de cette typologie, il est possible de distinguer trois grandes modalités d’interaction entre l’opérateur et le robot collaboratif : la co-présence, la coopération et la collaboration (Figure 2).

Figure 2 – Les trois grands régimes d’interaction entre l’opérateur et le robot collaboratif (inspiré de Schmidtler et al., 2015 et de Hentout et al., 2019)

Ces trois régimes d’interaction ont en commun la présence du robot collaboratif et de l’opérateur dans un même espace de travail au même moment.

La co-présence représente la forme d’interaction la plus simple entre l’opérateur et le robot collaboratif puisqu’elle se limite aux contacts involontaires. Dans ce cas de figure, le robot et l’opérateur co-existent dans le même espace de travail. Ils œuvrent sur la même chaîne de production mais à deux endroits différents de celle-ci ou sur le même objet mais pour effectuer une tâche différente. Par exemple, le robot s’occupe de mettre en boîte les produits en début de ligne et l’opérateur vérifie le contenu en bout de ligne, avant d’en fermer le couvercle. Si, en se déplaçant dans l’atelier, l’opérateur s’approche trop près du robot, celui-ci s’arrête immédiatement.

Dans le cas de figure de la coopération, le robot collaboratif et l’opérateur réalisent une tâche commune. Toutefois, la tâche s’avère suffisamment simple pour que le robot collaboratif et l’opérateur n’aient pas besoin de se coordonner pour venir à bout de celle-ci. Chacun peut agir sans avoir besoin du concours de l’autre pour mener à bien son travail. Par exemple, l’opérateur peut être en train de peindre la face avant d’un meuble pendant que le robot collaboratif peint la face arrière. Des capteurs plus avancés que ceux utilisés en cas de co-présence s’avèrent nécessaires pour réduire le risque de collision.

La collaboration représente le stade le plus avancé d’interaction, puisqu’il s’agit pour l’opérateur et le robot de réaliser ensemble une tâche plus complexe, c’est-à-dire qui nécessite une coordination. Par exemple, le robot tiendra le cadre d’un miroir d’une certaine manière pour que l’opérateur puisse graver une inscription dessus.

Comment répartir le travail : les objectifs derrière la collaboration

Comme le souligne Dumora (2014), la répartition du travail entre l’opérateur et le robot collaboratif peut répondre à divers objectifs. Par exemple, la machine peut se voir attribuer toutes les fonctions automatisables ou seulement les fonctions dont l’automatisation permettrait de réduire les coûts de production. Dans ces cas-là, la coordination entre l’opérateur et le robot en vue de réaliser une tâche commune ne cherchera pas forcément à mettre en avant les qualités de l’un et de l’autre. Autrement dit, l’opérateur travaillera de concert avec le robot mais cette collaboration n’aura pas pour but premier de valoriser les capacités cognitives, perceptives ou d’adaptabilité de celui-là. L’interaction entre les deux acteurs répondra à une autre finalité première, telle que la réduction des coûts.

Dumora (2014) présente un autre cas de figure dans lequel la collaboration avec le robot peut se révéler plus valorisante pour l’humain, la répartition du travail étant basée sur la complémentarité de leurs compétences. La logique derrière ce régime de division du travail est la suivante : la collaboration sera d’autant plus efficace et bienvenue par l’opérateur qu’elle met en valeur aussi bien ses qualités que celles du robot. Ainsi, le travail devra être distribué de telle sorte qu’entre autres, la dextérité et la flexibilité cognitive de l’humain soient complétées par la précision et la force du robot. Dans la suite de ce Doc, nous verrons comment Susana Sánchez Restrepo, dans le cadre de sa thèse, est partie de ce présupposé pour concevoir une « boîte à outils » logiciel qui laisse la maîtrise du robot collaboratif à l’opérateur aussi bien durant son fonctionnement que durant sa programmation.

Encadré 5 – Men are better at, machines are better at (MABA MABA)

La logique de complémentarité des compétences entre l’humain et le robot avait déjà été mise en avant il y a plus de cinquante ans, dans la célèbre liste à douze entrées de Fitts (1951). Le psychologue américain proposait de répartir le travail entre l’humain et la machine de manière comparative, c’est-à-dire en se demandant pour chaque fonction lequel des deux était mieux à même de la réaliser. Une telle stratégie d’allocation des rôles est parfois nommée MABA MABA dans la littérature, pour Men are better at, machines are better at. D’après Fitts, la machine présenterait des qualités supérieures en matière de temps de réaction, de force physique, de fonctionnement multitâche, de raisonnement déductif, de répétition d’une tâche et de mémoire à court terme; l’humain surpasserait quant à lui la machine par ses facultés de jugement, d’improvisation, de raisonnement inductif, de détection des irrégularités, de perception et par sa mémoire à long terme. Cette liste a été actualisée par de Winter et Hancock (2015) qui montrent que la machine dépasse désormais l’humain dans ces trois dernières facultés.

Deux formes de collaboration avancée : le cobot-outil et le cobot-collègue

Nous nous intéressons à présent à la troisième catégorie d’interaction entre l’opérateur et le robot présentée plus haut, à savoir le régime de la collaboration. Il est possible de distinguer deux cas de coordination entre le robot collaboratif et l’opérateur durant l’exécution d’une tâche commune : le cobot-outil et le cobot-collègue. Cette distinction peut être appréhendée à travers deux critères que sont la prise de décision quant au mouvement et la fréquence des contacts volontaires.

La prise de décision peut être le seul fait de l’opérateur ou partagée entre le robot et l’opérateur. Dans le cas du cobot-outil, le robot fait simplement ce qu’on lui dit de faire. Dans le cas du cobot-collègue, le robot peut générer de manière autonome un mouvement afin de s’adapter à celui de l’opérateur. Il peut également modifier son mouvement si le comportement de l’opérateur l’exige.

Le mouvement est aussi le résultat d’un échange d’informations entre le robot et l’opérateur. Cet échange peut se faire à travers un contact physique volontaire, comme par exemple le transfert de forces ou la transmission de signaux électriques entre l’opérateur et le robot collaboratif. La coordination peut aussi se faire sans contact, à travers un échange d’informations qui peut prendre plusieurs formes. L’opérateur peut s’adresser au robot par la parole, par des gestes, etc. pour déclencher une commande, par exemple, lui demander d’aller plus vite. Le robot peut observer l’opérateur pour connaître ses intentions en décodant ses expressions faciales, en analysant ses mouvements, etc. Ces diverses formes d’échange peuvent se produire aussi bien dans le cas du cobot-outil que dans le cas du cobot-collègue, à la différence près que le cobot-outil n’est pas autonome et fonctionne uniquement lorsque l’opérateur le prend en main (il y a donc toujours un contact physique dans ce cas-ci4.) Cette interaction peut être complétée par des commandes plus indirectes, par exemple vocales : l’opérateur pourrait demander au cobot-outil dont il se sert d’aller deux fois plus vite par la parole. Dans le cas du cobot-collègue, les contacts volontaires sont plus contingents : le cobot-collègue et l’opérateur peuvent très bien réaliser une tâche ensemble en étant simplement côte à côte, c’est-à-dire sans jamais n’avoir besoin de se toucher.

- 1 – Les statistiques de la Fédération internationale de robotique considèrent seulement les robots industriels répondant à la norme ISO 10218-1.

- 2 – Selon l’INRS (2020), les risques psychosociaux (RPS) sont associés à des situations de travail caractérisées par du stress, des conflits ou du harcèlement au sein de l’entreprise ou des agressions provenant de personnes n’appartenant pas à l’organisation.

- 3 – Notons qu’un pan de la recherche se consacre à l’élaboration de tels robots humanoïdes, dotés d’une intelligence émotionnelle et sociale (voir par exemple Tisseron, 2015 et Devillers, 2020). Aldebaran Robotics, aujourd’hui Softbank Robotics Europe, a conçu et commercialise les robots Pepper et Nao ; la société travaille actuellement sur l’expressivité de l’émotion et de la voix de Pepper ainsi que sur sa capacité à améliorer sa perception des émotions humaines (projet Affectiva) et sa représentation de la société.

- 4 – Nous utilisons bien le mot outil pour désigner des cas de comanipulation (Encadré 1).

Un nouvel assistant pour l’opérateur

Dans ce chapitre, nous souhaitons présenter le potentiel de collaboration offert par la cobotique. Ce type d’interaction en vue de réaliser une tâche commune nécessite des moyens technologiques avancés pour que le robot et l’opérateur puissent coordonner leurs gestes. Il s’agira de montrer que le robot collaboratif peut jouer le rôle d’assistant de deux grandes manières : comme outil, d’une part, en prolongeant le geste humain, comme collègue d’autre part, en travaillant aux côtés de l’opérateur et en adaptant son activité à la gestuelle de celui-ci.

Le cobot-outil

Un robot collaboratif peut accompagner le geste humain dans l’exécution d’une tâche et jouer alors le rôle d’outil. Susana Sánchez Restrepo a travaillé sur ce cas de figure dans le cadre de sa thèse. Plus précisément, elle s’est intéressée aux applications industrielles comme le ponçage, le vissage, le polissage ou l’assemblage, où le robot peut être utilisé comme un outil, de manière à rendre le travail de l’opérateur moins pénible.

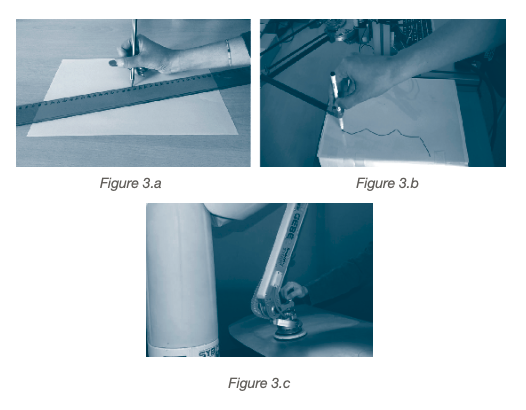

La figure 3 permet de mieux visualiser le mode d’interaction dont il est question ici. Nous voyons bien que l’opérateur et le robot travaillent « main dans la main » pour accomplir une tâche ensemble, dans le sens où ils collaborent à la réalisation d’une tâche du début jusqu’à la fin ; à aucun moment l’opérateur ne lâche le robot pour que celui-ci prenne la main et agisse en pleine autonomie. Autrement dit, le robot n’agit jamais seul, mais uniquement avec le concours de l’opérateur, ou plus précisément, lorsque celui-ci établit un contact physique avec lui. L’opérateur s’en sert donc comme il se servirait d’une visseuse, d’un fer à souder ou d’un autre outil. Néanmoins, le robot collaboratif peut être équipé d’une technologie désignée sous le nom de guide virtuel pour accompagner l’opérateur dans la réalisation d’un geste.

Le guidage virtuel : une assistance passive

Le guidage virtuel a été introduit dans le champ de la robotique par Rosenberg (1993), qui insiste sur les améliorations possibles au niveau de la pénibilité psychologique pour l’opérateur, du temps d’exécution et du taux d’erreurs, lors d’une tâche collaborative. Depuis ce travail séminal, les guides virtuels ont notamment été mis en application dans le domaine chirurgical (voir entre autres Ho et al., 1995 et Davies et al., 2006) et différentes industries, en particulier pour des tâches d’assemblage (voir Colgate et al., 2003 pour des exemples).

On parle également d’assistance passive car le robot ne fait que corriger le geste de l’opérateur en fonction des instructions communiquées : c’est bien l’opérateur qui initie ici le mouvement, le robot s’exécute en fonction. Si l’opérateur décide d’aller plus vite, le robot ira plus vite. La conduite assistée est un bon exemple d’assistance passive tiré de la vie courante. Le conducteur bénéficie d’un retour de force sur son volant pour être ramené vers le centre de la route lorsqu’il s’en écarte trop ; cette rétroaction découle des informations transmises par une caméra enregistrant les marquages au sol.

Figure 3 – Le système de guidage

Source : Raiola et al. (2018)

L’assistance passive part d’une idée simple. Lorsqu’un opérateur, aussi expert soit-il, doit effectuer de manière répétée un geste, il risque de voir son attention baisser après un certain temps, voire de se fatiguer. Un système de guidage sert précisément à soulager physiquement et mentalement l’opérateur, en générant des contraintes physiques de manière à empêcher certains mouvements indésirables. Tout comme avec l’utilisation d’une règle pour tracer des traits sans efforts et avec précision (Figure 3.a), un robot peut être programmé pour suivre une certaine trajectoire ou plus précisément, pour ramener la main de l’opérateur vers cette trajectoire lorsque celui-ci en dévie (Figure 3.b). Dans ce cas-là, le guidage est dit virtuel car le robot contraint le geste de l’opérateur en fonction d’une trajectoire enregistrée virtuellement, dans la mémoire du robot. Pour le dire plus simplement, le guide virtuel correspond à cette trajectoire enregistrée. Cette même technologie peut être appliquée pour guider la réalisation de tâches industrielles, comme l’a notamment montré Susana Sánchez Restrepo dans sa thèse (Figure 3.c).

Ainsi, l’opérateur qui manipule un robot collaboratif bénéficie d’un feedback sensoriel lors du guidage virtuel pour mieux réaliser son travail mais il reste maître du déroulé de la tâche. Ce guidage peut prendre la forme d’un feedback haptique, c’est-à-dire par la mobilisation du toucher. Exactement comme la règle, le robot collaboratif agit comme un moyen de contrôle automatique des gestes de l’opérateur : de fait, il exerce un retour de force sur la main de l’opérateur pour le contraindre à suivre une trajectoire donnée. Cela signifie que l’opérateur pourra facilement bouger le robot collaboratif le long de cette trajectoire mais ressentira une résistance mécanique lorsqu’il s’en éloigne.

L’apport possible de la réalité augmentée

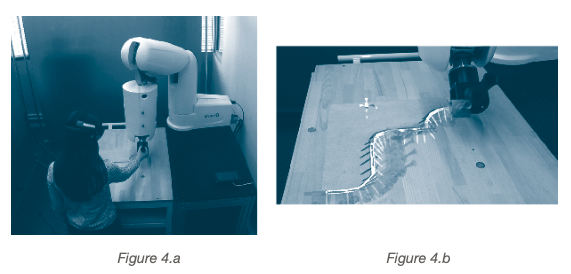

Figure 4 – La visualisation de la trajectoire par la réalité augmentée

Source : Sánchez Restrepo (2018)

Il est envisageable de compléter ce feedback haptique par une rétroaction visuelle. Susana Sánchez Restrepo a abordé cette perspective d’amélioration à la fin de sa thèse, en menant une expérience avec un casque de réalité augmentée (Figure 4.a) : en plus du retour de force évoqué à l’instant, le guidage virtuel pourrait s’instancier visuellement, par la projection sur le plan de travail directement de la trajectoire à suivre (Figure 4.b)5. Des améliorations au niveau du calibrage s’avèrent encore nécessaires pour que cette solution soit déployée dans l’industrie mais ce complément technologique peut rendre l’utilisation du guidage virtuel conçu par Susana Sánchez Restrepo encore plus intuitive. Grâce à la réalité augmentée, l’opérateur qui définit la trajectoire à suivre aurait comme l’impression de la « dessiner » sur son plan de travail directement.

Ce feedback visuel faciliterait aussi le roulement des opérateurs, en permettant à un nouvel utilisateur – qui n’a donc pas défini le guide virtuel à l’œuvre – de visualiser la trajectoire enregistrée précédemment par son collègue et partant, de mieux comprendre la tâche qu’il est censé reprendre. Ce gain en flexibilité semble particulièrement désirable dans le contexte de l’industrie 4.0, où les séries de production deviennent de plus en plus personnalisées.

L’opérateur garde toujours la main

La technologie sur laquelle a travaillé Susana Sánchez Restrepo n’autorise pas le robot à prendre des décisions par lui-même : l’opérateur agit d’abord et le robot s’exécute en conséquence. Par le biais d’une interaction physique, l’opérateur communique explicitement au robot la marche à suivre ; le robot se contente donc de reconnaître l’intention de l’opérateur qui se met en mouvement, c’est-à-dire de suivre les instructions explicitement communiquées par celui-ci.

Ce choix peut se justifier par la volonté de l’entreprise de laisser la main à l’opérateur quant à la prise de décision ; le robot collaboratif n’a d’autre rôle que d’assister celui-ci dans l’exécution du plan d’action. Puisque la collaboration homme-robot doit s’organiser autour d’une division des rôles répondant à la complémentarité de leurs compétences, l’opérateur, qui a des compétences cognitives plus élevées, une meilleure connaissance de l’environnement de travail et une bonne maîtrise du geste à effectuer, doit être responsable du plan d’action. Le robot, dont la précision et les capacités physiques sont supérieures à celles de l’humain et invariables dans le temps, s’en voit confier l’exécution en tant que telle.

Ainsi, le robot collaboratif de Susana Sánchez Restrepo ne dispose d’aucune autonomie, ses gestes étant conditionnés par la volonté, les instructions de l’opérateur. Le robot collaboratif joue bien uniquement le rôle d’outil, c’est-à-dire qu’il sert de moyen pour l’opérateur d’atteindre un but.

Le cobot-collègue

Une interaction proche d’une interaction humaine

Une autre manière pour l’opérateur de collaborer avec la machine est illustrée par ce que nous appelons le cas du cobot-collègue. À la différence du cobot-outil, il est doté de capacités cognitives qui le transforment en « collègue » à l’aide des technologies d’intelligence artificielle. Ses capacités lui permettent de s’adapter à un changement de comportement chez l’opérateur ou dans l’environnement, d’être utile à l’opérateur au bon moment et de ne pas le retarder dans l’exécution de son geste. Ainsi, le robot collaboratif participe à la prise de décision dans l’exécution d’une tâche avec l’opérateur. Ici, le mot collègue marque à la fois l’appartenance à la même organisation et le caractère « humain » de l’interaction par une communication qui se fait selon un langage similaire à celui qui serait utilisé entre deux opérateurs.

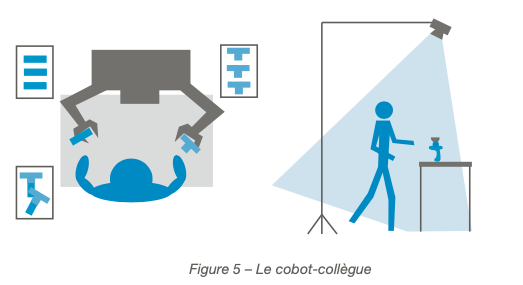

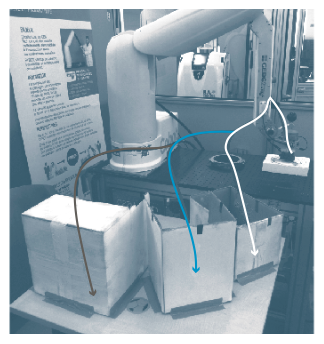

Ce type de robot collaboratif peut notamment être déployé sur des chaînes d’assemblage comme par exemple sur les postes de préparation manuelle (Figure 5). Dans le montage de raccords d’air de moteurs automobiles, l’opérateur doit prendre des pièces dans différents bacs et les assembler. Sur ces postes de préparation, il peut être difficile pour l’opérateur de piocher la bonne pièce, ce qui peut mener, d’une part, à des erreurs dans le choix des pièces et, d’autre part, à une pénibilité psychologique et une perte de temps pour l’opérateur. Le robot est alors introduit afin de tendre les bonnes pièces à l’opérateur.

Figure 5 – Le cobot-collègue

Source : Coupeté (2016)

Un autre exemple exploré dans le cas du projet Collaborate (Encadré 6) concerne l’assemblage de télévisions. Le robot et l’opérateur partagent le même espace de travail autour d’un convoyeur. Le robot assiste l’humain en lui apportant les cartes électroniques que celui-ci positionne sur un écran de télévision en cours d’assemblage.

Encadré 6 – Le projet Collaborate en quelques mots

Le projet Collaborate financé par le programme H2020 sous l’agrément 820767 a comme objectif de réduire de 20 % le temps et le coût de programmation et de 50% le temps et les coûts liés à l’étape de reconfiguration des robots sur les chaînes d’assemblage. Le projet doit également mener à une amélioration de la qualité du travail (chiffrée à 15%). Il réunit sept partenaires dont Mines ParisTech. Le projet s’articule autour de quatre business cases : l’assemblage de pièces de démarreur de voiture, le rivetage de structures dans l’aéronautique, l’assemblage de LED sur des téléviseurs et le contrôle qualité de pare-brise. Le projet mêle notamment l’apprentissage par la démonstration et l’apprentissage automatique : l’opérateur montre le geste à effectuer par la démonstration, le robot le reproduit à l’aide d’un algorithme d’apprentissage automatique (Chapitre 3).

Source : site du projet, https://collaborate-project.eu/

Le robot s’adapte à l’opérateur grâce à l’intelligence artificielle

Afin de parvenir à une coordination optimale, les mouvements du robot sont générés en tenant compte du comportement de l’opérateur. On parlera de coordination temporelle lorsque le robot s’adapte au rythme de l’opérateur ; la coordination spatiale fait quant à elle référence à la prise en considération des caractéristiques anthropométriques de l’opérateur, par exemple, en privilégiant les positions ergonomiques pour passer des pièces à l’opérateur en fonction de son gabarit.

Dans l’idéal, n’importe qui doit pouvoir interagir confortablement avec le robot collaboratif, notamment de manière à faciliter le roulement entre les opérateurs et à limiter les postures non ergonomiques. Ainsi, le robot peut être programmé pour placer l’objet plus bas pour un sujet de plus petite taille ou vers la main opposée si celui-ci est gaucher, contrairement à l’opérateur avec lequel le robot vient d’interagir.

Cette coordination est permise en dotant le cobot-collègue d’un système d’intelligence artificielle, c’est-à-dire de capacités cognitives qui sont habituellement associées à l’humain. Ces nouvelles capacités lui permettent en particulier de reconnaître le geste de l’opérateur, de pouvoir se synchroniser avec lui, d’adapter sa cadence mais aussi de comprendre si un événement inattendu se produit. Sur le poste d’assemblage décrit précédemment (Figure 5), le robot doit passer des pièces à l’opérateur qui va les assembler. L’objectif du système d’intelligence est de faire en sorte que le robot donne la pièce au moment voulu à l’opérateur afin de parvenir à une collaboration efficace entre l’opérateur et le robot sans que l’opérateur ne le lui formule par un contact physique ou par une programmation explicite. Cela doit être rendu possible même lorsque l’opérateur fait un mouvement inattendu – remettre ses lunettes – ou lorsqu’une personne se tient debout derrière l’opérateur pour le surveiller.

Précisons que l’intelligence artificielle est une condition nécessaire mais non suffisante du cobot-collègue : elle constitue un moyen technologique pour favoriser la synchronisation du robot avec l’opérateur mais elle peut très bien être déployée sur des robots qui ne sont pas collaboratifs. En d’autres termes, tous les robots dotés d’une intelligence artificielle ne sont pas des robots collaboratifs mais le cobot-collègue a besoin d’un système d’intelligence artificielle pour collaborer avec l’opérateur presque comme le ferait un collègue humain.

Encadré 7 – Ouvrir la boîte noire de l’intelligence artificielle

Le domaine de l’intelligence artificielle mobilisé par le centre de robotique de Mines ParisTech est l’apprentissage automatique ou machine learning. Il s’agit d’apprendre à des robots à reconnaître un geste, à exécuter une tâche ou plus généralement à prendre une décision sans qu’un humain n’ait programmé explicitement le robot au préalable; cet apprentissage se fait via des algorithmes nourris par une quantité importante de données. Ces algorithmes permettent au robot de construire un modèle de prise de décision qui sera la généralisation des règles apprises avec les données fournies en exemple. Pour faire un parallèle avec l’intelligence humaine, c’est comme si l’on cherchait à reproduire les routines humaines implicites, comme par exemple prendre un parapluie lorsqu’il pleut. On notera qu’à l’instar de la routine, on ne peut pas toujours expliquer les règles que suit la machine après son apprentissage…

On distingue plusieurs types d’apprentissage : l’apprentissage supervisé, l’apprentissage non supervisé et l’apprentissage par renforcement. Dans le cas de l’apprentissage supervisé, un humain attend un comportement précis du robot et lui fournit des exemples qui représentent le comportement attendu et le comportement non attendu. Le robot apprend de chaque exemple et ajuste ses paramètres de manière à réduire l’écart entre le résultat obtenu et le résultat attendu. L’apprentissage non supervisé se distingue du cas précédent par l’absence de catégorisation (comportement attendu vs non attendu) des exemples fournis au robot. Il doit trouver seul la catégorisation pertinente des données en fonction de leurs similitudes et de leurs différences. Dans le cas de l’apprentissage par renforcement, l’humain n’attend pas du robot un comportement précis. Le robot agit selon un procédé d’essais-erreurs. À chaque essai, il analyse la réaction de l’opérateur ; il poursuivra dans la même direction s’il reçoit un feedback positif comme une récompense de la part de ce dernier ou envisagera une autre piste dans le cas contraire. Le comportement à atteindre pour le robot sera le comportement qui recevra le plus de feedback positif de la part de l’humain.

Enfin, l’apprentissage profond ou deep learning fonctionne selon un modèle similaire à un réseau de neurones humains. Il s’agit d’un sous-ensemble du machine learning qui permet d’apprendre des tâches encore plus complexes : il mobilise donc une quantité importante d’informations et se caractérise par un traitement des données plus lourd.

- 5 – La réalité augmentée superpose des informations au monde réel, contrairement à la réalité virtuelle où ces informations sont projetées dans un environnement simulé.

Enseigner au robot à travailler avec l’opérateur

Nous avons montré jusqu’ici comment l’opérateur peut être assisté dans l’exécution d’une tâche par un robot collaboratif sans que cela ne lui demande d’efforts particuliers. Dans le cas du cobot-outil, l’opérateur manipule le robot comme bon lui semble – il garde donc toujours la main. Dans le cas du cobot-collègue, l’usage de l’intelligence artificielle peut fluidifier la collaboration entre l’opérateur et le robot puisqu’elle permet au robot de s’adapter automatiquement aux gestes de l’humain, c’est-à-dire sans que l’opérateur ne doive y prêter attention – il interagit avec lui presque aussi naturellement qu’il le ferait avec un collègue. Dans ce chapitre, nous nous intéressons à ce qui vient en amont de la collaboration en tant que telle : comment le robot peut-il apprendre à travailler avec l’opérateur ? Nous détaillons dans cette partie deux cas de figure : comment le robot peut apprendre à reconnaître les gestes humains et s’adapter ainsi à l’activité de l’opérateur, sans que celui-ci n’ait à lui indiquer quoi que ce soit, et comment l’opérateur peut utiliser une interface intuitive pour enseigner au robot le geste précis qu’il devra reproduire.

Reconnaître les gestes pour s’adapter

Nous avons vu que le cobot-collègue s’adapte à l’opérateur ; pour cela, il doit en reconnaître les gestes, ce que permet l’apprentissage automatique. Selon Coupeté et al. (2015), un système de reconnaissance des gestes efficace est un système i) pouvant reconnaître les gestes effectués par l’opérateur sans le gêner durant son travail, ii) permettant la synchronisation du robot avec l’opérateur, iii) limitant une mauvaise reconnaissance des gestes de l’opérateur par le robot. La reconnaissance est rendue plus complexe dès lors qu’il existe un ordre précis des tâches à effectuer. Il faut que le système de reconnaissance fonctionne pour un grand nombre d’opérateurs, chaque opérateur ayant sa propre façon de faire le geste et surtout son propre rythme. Le système doit aussi être capable de s’adapter à l’arrivée de nouveaux opérateurs. Un dernier enjeu réside dans la minimisation du temps d’apprentissage du robot.

De manière générale, la mise au point d’un système de reconnaissance des gestes par apprentissage automatique suppose plusieurs étapes. Nous détaillons ici la méthode développée par les chercheurs du centre de robotique de Mines ParisTech6.

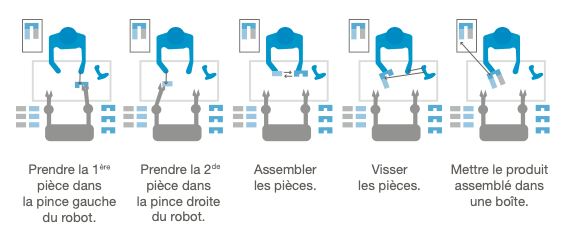

Tout d’abord, il s’agit de choisir les gestes de l’opérateur que le robot doit reconnaître. Pour cela, la tâche effectuée par l’opérateur est décomposée en différents gestes (Figure 6).

Figure 6 – La décomposition des gestes à reconnaître dans le montage de raccords d’air de moteurs automobiles (traduction par La Fabrique de l’industrie)

Source : Coupeté et al. (2016b)

La deuxième étape consiste à choisir la manière dont on va collecter des informations sur le mouvement effectué par l’opérateur, en d’autres termes le capteur des gestes (par exemple une caméra). Cette étape suppose de prendre en compte les contraintes du milieu industriel : il faut en effet faire attention à ce que le capteur ne soit pas un facteur de gêne pour l’opérateur en train d’exécuter son geste. Le positionnement des capteurs est donc un élément à considérer ; le choix fait par Coupeté et al. (2016b) est de mettre une caméra au-dessus du poste de travail.

La collecte effective des gestes à reconnaître est l’étape suivante. Plus on filmera un nombre important d’opérateurs exécutant leurs gestes, plus les données fournies au modèle d’apprentissage seront nombreuses et plus le système de reconnaissance final sera robuste face aux changements dans l’exécution d’un geste par un opérateur.

Toutefois, le robot n’est pas capable de « regarder » le film qu’on vient de faire et d’en extraire les informations pertinentes à retenir pour reconnaître le geste. L’étape suivante consiste donc en la constitution d’une base de données que le robot sache lire et qui sera traitée par la suite à l’aide de modèles statistiques7. Plus précisément, il s’agit d’extraire les principales caractéristiques du geste de l’opérateur qui permettront au robot de reconnaître l’action de l’opérateur, par exemple la position des mains ou la posture de l’opérateur filmé.

L’étape suivante constitue la reconnaissance du geste elle-même par l’apprentissage automatique. L’objectif est de prédire le geste qu’est en train d’effectuer l’opérateur à partir des données sur la posture des mains. En termes statistiques, on cherche à déterminer la classe la plus probable à laquelle appartient un geste parmi un ensemble de gestes que le robot a déjà appris à reconnaître à l’aide des données sur la posture des mains. La détermination de la classe d’appartenance se fait à l’aide d’un classifieur (classifier), autrement dit une famille d’algorithmes de classement statistique : le classifieur va attribuer une valeur à la position des mains, cette valeur correspondant à une catégorie (par exemple, de manière très simplifiée, la position des mains est horizontale, le robot classe cette position dans la catégorie qui est « l’opérateur est en train de tendre la pièce à visser »). Le choix du modèle statistique qui mène à cette classification dépend des objectifs attribués au robot collaboratif : si l’on souhaite qu’il soit capable de prendre en considération le rythme d’exécution de l’opérateur, alors on choisira un modèle incorporant une dimension temporelle8. Il dépend également de sa performance en termes de reconnaissance correcte du geste. On privilégiera une méthode qui maximise le taux de classification du geste dans la bonne catégorie.

Le système de reconnaissance des gestes est alors prêt à être utilisé. Mais il est encore possible, d’une part, d’ajouter des capteurs sur les outils utilisés par l’opérateur pour avoir des informations complémentaires sur leur utilisation et, d’autre part, d’actualiser la base de données pour prendre en compte les caractéristiques de nouveaux opérateurs.

Encadré 8 – Les étapes-clés dans la mise en place d’un système de reconnaissance des gestes

1. Choix des gestes à reconnaître : découper une tâche en différents gestes que le robot peut comprendre.

2. Choix du capteur (caméra, etc.) et son positionnement en prenant en compte les contraintes du milieu industriel.

3. Acquisition de la base de données d’apprentissage : il est nécessaire d’avoir un nombre important d’opérateurs, au-dessus de dix, pour être robuste aux variabilités dans l’exécution des gestes.

4. Choix de la description du mouvement : le geste effectif, les positions des mains, la posture de l’opérateur filmé.

5. Choix du classifieur (la famille d’algorithmes de classement statistique).

6. Ajout de capteurs sur les outils pour avoir des informations sur leur utilisation. 7. Actualisation de la base de données aux nouveaux opérateurs.

Source : Coupeté (2016)

Dans la pratique, ce sont les ingénieurs, les techniciens et les ergonomes qui conçoivent et fournissent la version bêta du système robotisé permettant la réalisation de la tâche. Les opérateurs interviennent dans la phase d’apprentissage en fournissant les exemples à partir desquels le robot va apprendre (Encadré 8, étapes 3 et 7). L’apprentissage automatique modifie le travail de programmation : au lieu de fournir un nombre élevé de règles au système, ce dernier est petit à petit capable d’apprendre par lui-même. Bien sûr, s’il s’avère nécessaire d’attribuer une nouvelle tâche au robot ou de réorganiser la chaîne d’assemblage, l’opérateur ne pourra pas le faire seul sans formation complémentaire : comme nous venons de le voir, une expertise technique sera requise car il faudra sûrement positionner différemment les capteurs, modifier la banque de données sur laquelle le robot base son apprentissage, etc.

Apprendre par l’imitation

Afin d’accroître la flexibilité de la production, on peut rechercher une technologie permettant d’impliquer directement l’opérateur dans la programmation du robot. Ont été développées à ce titre des interfaces plus intuitives, qui raccourcissent la chaîne d’intermédiaires. Tel est l’objectif de la méthode de programmation dite par la démonstration (ou PbD pour programming by demonstration). Grâce à cette technologie, l’opérateur peut enseigner le geste à effectuer au robot lui-même, depuis son poste de travail ; cela veut dire aussi qu’il peut facilement reprogrammer le robot tout seul, ce qui représente un atout majeur dans le contexte de l’industrie 4.0 et des séries personnalisées9.

Plus précisément, la PbD permet au robot d’apprendre par observation puis imitation, raison pour laquelle cette technique de programmation est aussi connue sous le nom d’apprentissage mimétique. Dans un cas spécifique de PbD, l’opérateur peut montrer littéralement au robot, en lui tenant le bras, le mouvement à effectuer, comme un professeur de badminton tiendrait la main de son élève pour lui enseigner le geste du lob. On parle alors d’enseignement kinesthésique.

Notons qu’en règle générale, cette méthode sert à enseigner un geste au robot, dans le but qu’il le reproduise ultérieurement. Comme nous l’avons vu dans la partie 2.1, dans la thèse de Susana Sánchez Restrepo, la PbD est utilisée pour programmer la trajectoire qui servira de guide virtuel pour l’opérateur par la suite. Il ne s’agit donc pas de programmer le robot collaboratif pour qu’il travaille en autonomie mais bien de manière à faciliter la répétition d’une tâche réalisée main dans la main avec l’opérateur.

Différentes interfaces d’apprentissage

Dans ses travaux (Sánchez Restrepo, 2018 ; Sánchez Restrepo et al., 2017 ; 2020), Susana Sánchez Restrepo a fait le choix de recourir à l’enseignement kinesthésique de manière à ce que l’opérateur puisse indiquer le geste à effectuer au robot collaboratif en le déplaçant avec la main. Vakanski (2017) rappelle qu’il existe d’autres modalités de PbD, c’est-à-dire d’autres manières pour l’opérateur de montrer au robot quoi faire. De fait, le robot peut également observer et enregistrer les mouvements de l’opérateur ainsi que les changements liés à l’environnement grâce aux interfaces d’apprentissage suivantes :

‒ le contrôle direct : l’opérateur utilise une console de type tablette pour diriger les mouvements du robot ;

‒ le téléguidage : l’opérateur manipule un dispositif « maître », pour piloter à distance un dispositif « esclave » présent sur la ligne de production ;

‒ le feedback sensoriel : l’environnement de travail peut être équipé de caméras ou autres capteurs pour communiquer au robot des informations en lien avec la position dans l’espace, la vitesse, la force, etc. d’un geste réalisé par l’opérateur qu’il devra reproduire ultérieurement ;

‒ la réalité virtuelle ou augmentée : l’opérateur peut se servir de manettes et d’un casque de réalité virtuelle ou de réalité augmentée pour montrer au robot quel geste effectuer, respectivement, dans un environnement simulé ou dans son environnement réel avec l’aide d’informations projetées directement sur son plan de travail (par exemple, un quadrillage pour bien dimensionner la coupe à réaliser).

Une méthode itérative avantageuse pour l’opérateur

L’enseignement kinesthésique prévu par Susana Sánchez Restrepo repose sur une méthode itérative : la trajectoire qui servira de guide virtuel à l’opérateur dans l’exécution d’une tâche se précise à mesure que le geste est répété. Autrement dit, le mouvement doit être réalisé un certain nombre de fois pour que sa trajectoire soit mémorisée avec précision et que le robot l’utilise pour guider efficacement l’opérateur lors des itérations qui suivront.

Le caractère répétitif de la démarche s’avère toutefois peu pénible physiquement pour l’opérateur, car le guidage virtuel se met en marche après la première démonstration. En effet, le guidage virtuel tel qu’il a été présenté dans la partie 2.1 est enclenché à partir de la deuxième itération. En d’autres termes, l’utilisateur bénéficie du feedback sensoriel du robot durant les itérations suivantes, destinées à préciser la trajectoire à suivre lors d’une tâche de production. Pour le dire plus simplement encore, l’opérateur réitère son geste un certain nombre de fois mais n’a plus besoin d’exercer la même force après la première démonstration10.

En outre, comme l’opérateur interagit physiquement avec le robot pour réaliser une tâche en commun avec lui, il reçoit du feedback directement de sa part et non pas de manière interposée11. Ce qui veut dire que l’opérateur est mieux intégré dans la réalisation de la tâche et peut dès lors se rendre compte de manière plus intuitive des ajustements qu’il lui semble éventuellement nécessaire d’apporter à la trajectoire enregistrée.

Enfin, l’approche itérative adoptée par Susana Sánchez Restrepo permet de limiter la pénibilité psychologique pour l’opérateur devant programmer la tâche. De fait, celui-ci n’est pas contraint par un nombre prédéfini d’itérations. Il peut donc faire autant de démonstrations – et d’erreurs – qu’il le souhaite ; cela signifie que l’opérateur à qui incombe la programmation du robot n’a pas besoin d’avoir une attention soutenue en continu, contrairement au cas où il aurait un nombre limité d’essais.

Autre avantage de cette méthode : elle favorise doublement la polyvalence. D’une part, l’opérateur peut aisément modifier la trajectoire pour redéployer le robot sur une autre tâche, comme illustré par les différents traits de couleur sur la figure 7.

Figure 7 – Les multiples trajectoires possibles

Source : Sánchez Restrepo (2018)

D’autre part, le roulement entre les équipes en est facilité : grâce au guidage virtuel, un opérateur peut remplacer un collègue sur une tâche à n’importe quel stade de sa programmation. Il pourra reprendre la production là où elle a été arrêtée, en suivant la trajectoire rodée par son collègue, parfaire une trajectoire pour laquelle peu d’itérations ont été enregistrées, voire la modifier s’il la juge inefficiente ou inadaptée.

- 6 – Nous renvoyons ici aux travaux de Coupeté (2016), Coupeté et al. (2015, 2016a).

- 7 – On parle ici de feature engineering.

- 8 – Un exemple de modèle statistique fréquemment utilisé pour permettre au robot d’adapter sa cadence à celle de l’opérateur et qui est mobilisé par le centre de robotique de Mines ParisTech est le modèle de Markov caché ou Hidden Markov Models (HMM).

- 9 – Notons que dans le cas du cobot-outil, l’apprentissage automatique pourrait être mobilisée conjointement avec la programmation par la démonstration pour générer la trajectoire à intégrer dans le guide virtuel (Raiola, 2017 ; Raiola et al., 2018) : l’intelligence artificielle servirait alors d’outil informatique pour définir la trajectoire optimale en fonction des démonstrations faites par l’opérateur et de certains paramètres donnés (contraintes mécaniques, vitesse, etc.). De même, si le cobot-collègue a besoin de l’intelligence artificielle pour bien remplir son rôle, son système de reconnaissance des gestes pourrait être complété par l’apport de la programmation par la démonstration (Encadré 6) : l’opérateur peut au préalable enseigner au robot les gestes qui figureront ensuite dans sa bibliothèque de réponses possibles au comportement humain observé.

- 10 – Pour rendre la programmation du robot encore moins pénible, la démonstration peut être remplacée par des outils préprogrammés dès la première itération. Par exemple, les trajectoires peuvent être enregistrées au préalable : on peut imaginer quelques trajectoires définies par défaut par un ingénieur roboticien. Un opérateur peut aussi simplement faire la démonstration de deux points pour créer une ligne droite, de trois points pour créer un arc de cercle, etc.

- 11 – Dans le cas d’un robot téléguidé, l’information en provenance de l’environnement est d’abord interprétée par le dispositif « esclave » avant d’être communiquée au dispositif « maître » et enfin présentée à l’utilisateur à l’aide d’un feedback visuel ou haptique.

Conclusion

Depuis les premiers modèles industriels des années 1960, de nombreux progrès contribuent à rendre l’utilisation et la programmation des robots plus flexibles. La robotique collaborative représente l’un des avatars de cette industrie du futur. Nous avons vu ici qu’elle peut présenter différentes formes qui partagent néanmoins une caractéristique fondamentale : le robot collaboratif se définit par sa sécurité intrinsèque qui lui permet d’œuvrer dans le même espace de travail que l’opérateur. Sorti de sa cage traditionnelle, le robot collaboratif est alors susceptible d’entrer en interaction directe avec l’opérateur. Quelles nouvelles relations peut-il nouer avec l’humain ? Avec quelles conséquences pour le travail de l’opérateur ?

Collaborer avec la machine : trois grands changements pour l’opérateur

Premièrement, la robotique collaborative offre une nouvelle forme d’assistance dans la réalisation d’une tâche. Suffisamment sûr pour partager le même espace de travail que l’opérateur, le robot peut dès lors collaborer avec celui-ci de deux grandes manières : comme outil, qui s’exécute uniquement en fonction des commandes données par l’opérateur ; comme collègue, équipé d’une intelligence artificielle pour s’adapter automatiquement aux gestes de l’opérateur.

Deuxièmement, elle rend le travail moins pénible. Cette nouvelle assistance présente l’avantage de soulager physiquement et psychologiquement l’opérateur, facilitant ainsi l’intégration des femmes et des seniors dans l’industrie. Par exemple, le cobot-collègue est chargé des tâches considérées comme pénibles psychologiquement pour l’opérateur, comme celle de sélectionner les bonnes pièces à assembler sur les chaînes de montage de raccords d’air. Ou encore, dans le cas du cobot-outil, la dextérité de l’opérateur est couplée à la force du robot, ce qui rend l’exécution de la tâche moins pénible physiquement pour ce dernier.

Troisièmement, elle favorise la montée en autonomie et la polyvalence. Tout d’abord, la technique dite de programmation par la démonstration s’incarne dans des interfaces intuitives grâce auxquelles l’opérateur peut lui-même, sans l’aide d’un ingénieur et sans avoir besoin d’être formé, déployer le robot sur une autre tâche, en lui montrant le nouveau geste à effectuer. Ensuite, même dans le cas du cobot-collègue où la prise de décision est partagée, le robot est programmé pour s’adapter au comportement humain et pas l’inverse. Enfin, dans le cas du cobot-outil, l’assistance au guidage permet à n’importe qui de reprendre une tâche mise en pause par un collègue : l’opérateur reprenant la main n’aura qu’à suivre la trajectoire déjà enregistrée ; quant au cas du cobot-collègue, l’adaptation automatique à la cadence voire même au gabarit de l’opérateur permettra à celui-ci de passer plus facilement d’un poste à l’autre.

Bien que sorti de sa cage, le robot collaboratif, qui a notamment pour objectif de soulager l’opérateur physiquement et psychologiquement, reste donc bel et bien un robot – robota, le terme d’origine tiré de la célèbre pièce de théâtre de Karel Čapek datant de 1920, signifie « travail, corvée, besogne » en tchèque. La robotique collaborative restant à l’heure actuelle une niche en matière de commercialisation, une question demeure encore ouverte concernant le cas de figure que nous avons nommé le cobot-collègue : aussi humaine soit cette nouvelle machine, grâce aux promesses de l’intelligence artificielle, l’opérateur de demain l’acceptera-t-il vraiment comme son alter ego ? Se sentira-t-il à l’aise à ses côtés ? Prendra-t-il soin de lui et prendra-t-il du plaisir à collaborer avec lui comme avec n’importe quel autre collègue ?

Bibliographie

Acemoglu, D. et Restrepo, P. (2019). Automation and New Tasks: How Technology Displaces and Reinstates Labor. Journal of Economic Perspectives , 33 (2), 3-30.

Acemoglu, D., Lelarge, C. et Restrepo, P. (2020). Competing with Robots: Firm-Level Evidence from France. AEA Papers and Proceedings 110, 383-388

Agence nationale de santé publique. (2020). Troubles musculo-squelettiques : la maladie. Disponible sur https://www.santepubliquefrance.fr/maladies-et-traumatismes/maladies-liees-au-travail/troubles-musculo-squelettiques/la-maladie, consulté le 1er juillet 2020.

Agence nationale pour l’amélioration des conditions de travail. (2007). L’approche économique des TMS… Intégrer la prévention à la performance. Disponible sur https://travail-emploi.gouv.fr/IMG/pdf/approche_economique_des_TMS.pdf, consulté le 17 juillet 2020.

Arntz, M., Gregory, T. et Zierahn, U. (2016). The Risk of Automation for Jobs in OECD Countries. OECD Social, Employment and Migration Working Papers, 189. Paris : é ditions OCDE.

Bidet-Mayer, T. (2015). Automatisation, emploi et travail. Les Synthèses de La Fabrique, 1, décembre.

Bourdu, E. et Weil, T. (2017). Numérique et emploi : quel bilan ?. Les Synthèses de La Fabrique, 12, avril.

Bowles, J. (2014). The Computerisation of European Jobs. Disponible sur http://www.bruegel.org/nc/blog/detail/article/1394-the-computerisation-of-european-jobs, consulté le 3 février 2020.

Colgate, J. E., Edward, J., Peshkin, M. A. et Wannasuphoprasit, W. (1996). Cobots: Robots for Collaboration with Human Operators. Proceedings of the 1996 ASME International Mechanical Engineering Congress and Exhibition Haptics Symposium, 58, 433–439.

Colgate, J. E., Peshkin, M. A. et Klostermeyer, S. H. (2003). Intelligent Assist Devices in Industrial Applications: A Review. Proceedings of the IEEE/RSJ International Conference on Intelligent Robots and Systems, octobre.

Coupeté, E. (2016). Reconnaissance de gestes et actions pour la collaboration homme-robot sur chaîne de montage (Thèse de doctorat en sciences des métiers de l’ingénieur, Université de recherche Paris Sciences et Lettres, préparée à Mines ParisTech et soutenue le 10 novembre 2016).

Coupeté, E., Moutarde, F. et Manitsaris, S. (2015). Gesture Recognition Using a Depth Camera for Human Robot Collaboration on Assembly Line. Procedia Manufacturing, 3, 518-525.

Coupeté, E., Moutarde, F., Manitsaris, S. et Hugues, O. (2016a). Recognition of Technical Gestures for Human-Robot Collaboration in Factories. The Ninth International Conference on Advances in Computer-Human Interactions , avril, Venise, Italie.

Coupeté, E., Weistroffer, V., Hugues, O., Moutarde, F., Manitsaris, S. et Fuchs, P. (2016b). New Challenges for Human-Robot Collaboration in an Industrial Context: Acceptability and Natural Collaboration. Fifth Workshop «Towards a Framework for Joint Action », iEEE RO-MAN 2016, août, New York, États-Unis.

Davies, B., Jakopec, M., Harris, S. J., Rodriguez Y Baena, F., Barrett, A., Evangelidis, A., Gomes, P., Henckel, J. et Cobb, J. (2006). Active-Constraint Robotics for Surgery. Proceedings of the IEEE, 94(9), 1696–1704.

Devillers, L. (2020). Les robots « émotionnels ». Paris : Les Éditions de l’Observatoire.

Dumora, J. (2014). Contribution à l’interaction physique homme-robot : Application à la comanipulation d’objets de grandes dimensions (Thèse de doctorat en systèmes automatiques et microélectroniques, Université de Montpellier 2, soutenue le 12 mars 2014).

Fédération internationale de robotique (2019). Présentation de la conférence de presse, 18 septembre, Shanghai, Chine. Disponible sur https://ifr.org/downloads/press2018/IFR%20World%20Robotics%20Presentation%20-%2018%20Sept%202019, consulté le 14 février 2020.

Fitts, P. M. (1951). Human Engineering for an Effective Air Navigation and Traffic Control System . National Research Council, National Academy of Sciences, Washington, D.C. : National Research Council, National Academy of Sciences.

Frey, C. B. et Osborne, M. (2013). The Future of Employment. How Susceptible Are Jobs to Computerisation. Oxford Martin School Working Papers, septembre.

Frey, C. B. et Osborne, M. (2017). The Future of Employment: How Susceptible Are Jobs to Computerisation?. Technological Forecasting and Social Change , 114 , 254-280.

Hentout, A., Aouache, M., Maoudj, A. et Akli, I. (2019). Human–Robot Interaction in Industrial Collaborative Robotics: A Literature Review of the Decade 2008–2017. Advanced Robotics , 33 (15-16), 764-799.

Ho, S. C., Hibberd, R. D. et Davies, B. L. (1995). Robot Assisted Knee Surgery. IEEE Engineering in Medicine and Biology Magazine, 14(3), 292–300.

Institut national de recherche et de sécurité. (2019). Dossier pénibilité au travail. Disponible sur www.inrs.fr/demarche/penibilite.html, consulté le 17 juillet 2020.

Institut national de recherche et de sécurité. (2020). Dossier risques psychosociaux. Disponible sur www.inrs.fr/risques/psychosociaux, consulté le 17 juillet 2020.

Lamy, X. (2011). Conception d’une interface de pilotage d’un cobot (Thèse de doctorat en robotique, Université Pierre et Marie Curie – Paris VI, soutenue le 7 mars 2011).

Le Ru, N. (2016). L’effet de l’automatisation sur l’emploi : ce qu’on sait et ce qu’on ignore. La Note d’analyse de France Stratégie, 16, juillet.

Lucke, D., Constantinescu, C. et Westkämper, E. (2008). Smart Factory – A Step Towards the Next Generation of Manufacturing. Dans Mitsuishi, M., Ueda, K. et Kimura, F. (dir). Manufacturing Systems and Technologies for the New Frontier. Londres : Springer.

Mercier, M. et Savary, R.-P. (2019). Demain les robots : vers une transformation des emplois de service. Rapport d’information n°162 fait au nom de la délégation sénatoriale à la prospective, déposé le 28 novembre 2019.

Moniz, A. B. et Krings, B. J. (2016). Robots Working with Humans or Humans Working with Robots? Searching for Social Dimensions in New Human-Robot Interaction in Industry. Societies 6

Moulieres-Seban, T., Bitonneau, D., Thibault, J-F., Salotti, J-M. et Claverie, B. (2016). Les interactions homme-robot pour la cobotique industrielle, Congrès Ergo’IA, 6-8 juillet, Biarritz, France.

Raiola, G. (2017). Co-manipulation with a Library of Virtual Guides (Thèse de doctorat en automatique, Université Paris-Saclay, préparée à l’ENSTA-ParisTech, soutenue le 2 février 2017).

Raiola, G., Sánchez Restrepo, S., Chevalier, P., Rodriguez-Ayerbe, P., Lamy, X., Tliba, S. et Stulp, F. (2018). Co-manipulation with a Library of Virtual Guiding Fixtures. Autonomous Robots, 42(5), 1037-1051.

Ras, E., Wild, F., Stahl, C. et Baudet, A. (2017). Bridging the Skills Gap of Workers in Industry 4.0 by Human Performance Augmentation Tools: Challenges and Roadmap. Proceedings of the 10 th International Conference on Pervasive Technologies Related to Assistive Environments, 428-432.

Rosenberg, L. B. (1993). Virtual Fixtures: Perceptual Tools for Telerobotic Manipulation. IEEE Virtual Reality Annual International Symposium , 18-22 septembre, Seattle, États -Unis.

Sánchez Restrepo, S. (2018). Intuitive, Iterative and Assisted Virtual Guides Programming for Human-Robot Comanipulation (Thèse de doctorat en robotique, Université Paul Sabatier-Toulouse III, soutenue le 1 er février 2018).

Sánchez Restrepo, S., Raiola, G., Chevalier, P., Lamy, X. et Sidobre, D. (2017). Iterative Virtual Guides Programming for Human-Robot Comanipulation. 2017 IEEE International Conference on Advanced Intelligent Mechatronics (AIM) , 219-226.

Sánchez Restrepo, S., Raiola, G., Guerry, J., D’Elia, E., Lamy, X. et Sidobre, D. (2020). Toward an Intuitive and Iterative 6D Virtual Guide Programming Framework for Assisted Human–Robot Comanipulation. Robotica , 1-29.

Schmidtler, J., Knott, V., Hölzel, C. et Bengler, K. (2015). Human Centered Assistance Applications for the Working Environment of the Future. Occupational Ergonomics , 12 (3), 83-95.

Sharma, A. (2018). Universal Robots Continues to Dominate Cobot Market but Faces Many Challengers , (Extrait du rapport Collaborative Robots – 2018 écrit par Interact Analysis). Disponible sur https://www.interactanalysis.com/universal-robots/, consulté le 3 février 2020.

Tisseron, S. (2015). Le jour où mon robot m’aimera. Paris : Albin Michel.

Vakanski, A. et Janabi-Sharifi, F. (2017). Robot Learning by Visual Observation. Hoboken : John Wiley & Sons.

de Winter, J. C. F. et Hancock, P. A. (2015) Reflections on the 1951 Fitts List: Do Humans Believe Now that Machines Surpass them?. Procedia Manufacturing 3

Collaborer avec la machine : quels changements pour l’opérateur ? – Les Docs de La Fabrique – Anne-Sophie Dubey et Caroline Granier. Avec la participation de Susana Sánchez Restrepo, Alina Glushkova et Sotiris Manitsaris